Modelele AI de tip LLM (Large Language Model) au evoluat rapid în ultimii ani, iar în 2026 există numeroase opțiuni performante, atât comerciale, cât și open-source. Unele modele sunt optimizate pentru programare, altele pentru conversație, analiză de documente sau generare de conținut.

Un avantaj major al multor modele AI moderne este că pot fi rulate local pe propriul computer, fără costuri de API sau dependență de cloud. În acest articol vei descoperi cele mai bune modele AI tip LLM în 2026, precum și metode simple pentru a le instala și utiliza local.

Ce este un LLM

Un LLM (Large Language Model) este un model de inteligență artificială antrenat pe cantități foarte mari de text. Aceste modele pot:

- genera text

- răspunde la întrebări

- scrie cod

- traduce

- analiza documente

- rezuma informații

Performanța unui model este influențată de mai mulți factori:

- numărul de parametri

- calitatea datelor de antrenament

- optimizările arhitecturale

- modul de inferență (cloud sau local)

În 2026, diferențele dintre modelele open-source și cele comerciale sunt din ce în ce mai mici.

Cele mai performante LLM în 2026

Llama 3

Llama 3 este unul dintre cele mai populare modele open-source disponibile în prezent.

Modelul este dezvoltat de compania Meta și oferă performanță foarte bună pentru:

- conversație

- generare de conținut

- analiză text

- programare

Avantaje:

- performanță ridicată pentru dimensiunea modelului

- comunitate foarte mare

- suport excelent pentru rulare locală

Versiunile de 8B și 70B parametri sunt cele mai utilizate.

Mistral

Mistral este un model dezvoltat de compania franceză Mistral AI și este cunoscut pentru eficiența sa.

Deși modelele sunt relativ mici, ele oferă performanțe foarte bune comparativ cu dimensiunea lor.

Avantaje:

- foarte eficient pe hardware modest

- rapid la inferență

- ideal pentru aplicații locale

Modele populare includ Mistral 7B și variantele optimizate pentru instrucțiuni.

DeepSeek

DeepSeek este unul dintre modelele care au atras foarte multă atenție în ultimii ani, mai ales pentru performanța sa în programare.

Este adesea comparat cu modele comerciale pentru sarcini precum:

- generare de cod

- rezolvare probleme tehnice

- analiză logică

Există variante specializate precum DeepSeek Coder, optimizate pentru dezvoltatori.

Phi

Phi este o familie de modele dezvoltate de Microsoft.

Aceste modele sunt cunoscute pentru faptul că sunt foarte mici, dar surprinzător de capabile.

Avantaje:

- consum redus de memorie

- performanță bună pentru dimensiunea modelului

- ideale pentru rulare pe laptopuri

Modelele Phi sunt o alegere excelentă pentru aplicații locale sau embedded.

Gemma

Gemma este familia de modele open-source lansată de Google. Aceste modele AI sunt optimizate pentru eficiență și pot fi rulate local pe hardware relativ modest.

Avantaje:

- optimizare bună pentru inferență

- suport în ecosistemul open-source

- performanță competitivă

Qwen

Qwen este o familie de modele LLM și multimodale open-source, dezvoltate de Alibaba Cloud.

Avantaje:

- Modele text, imagine și audio

- Suport pentru sute de limbi

- Opțiuni variate: de la modele mici (0.6B) la variante dense și Mixture-of-Experts (peste 300B parametri)

- Multe variante open-weight pentru rulare locală

Recomandări pentru rulare locală:

- Modelele Qwen de 8B sau optimizate (quantized) rulează pe PC-uri cu 16–32 GB RAM

- Modelele mari (>30B) necesită GPU puternic și optimizare.

Cum alegi un model LLM

Alegerea modelului depinde de scopul utilizării.

| Scop | Modele recomandate |

|---|---|

| Creare de conținut | Llama, Mistral, Gemma, Qwen |

| Programare | DeepSeek, Phi, Llama, GPT OSS |

| Hardware modest | Phi, Mistral 7B, Qwen 8B quantized |

Cum poți rula aceste modele AI local

Unul dintre cele mai interesante aspecte ale modelelor AI moderne este că multe pot fi rulate direct pe computerul personal.

De exemplu, un laptop cu CPU modern (Intel i5 / Ryzen 5), 16GB RAM si aproximativ 20GB spațiu liber pe SSD poate rula deja modele AI de aproximativ 7 miliarde de parametri dacă sunt optimizate prin tehnici de quantizare.

Interfețe populare pentru rulare LLM local

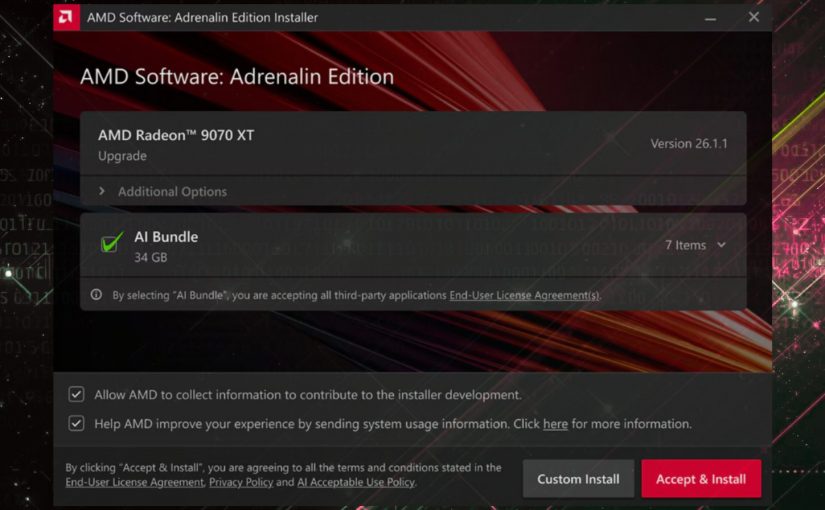

Există câteva aplicații care simplifică foarte mult instalarea modelelor.

LM Studio

LM Studio este una dintre cele mai simple aplicații pentru rularea modelelor LLM local.

Caracteristici principale:

- interfață grafică simplă

- browser integrat de modele

- chat similar cu ChatGPT

- server API local

Procesul este foarte simplu:

- instalezi aplicația

- descarci un model

- începi să folosești chat-ul AI

Ollama

Ollama este o platformă foarte populară pentru rularea LLM-urilor pe PC.

Este preferată mai ales de dezvoltatori deoarece permite integrarea rapidă în aplicații.

Un exemplu simplu de utilizare:

ollama run llama3

Comanda descarcă modelul și pornește o sesiune de chat AI direct în terminal. Platforma are disponibilă și o interfață grafică intuitivă: Ollama-Gui.

Cerințe hardware pentru rularea LLM local

Configurația minimă recomandată:

- CPU: modern (Intel i5 / Ryzen 5)

- RAM: 16GB DDR4

- unitate de stocare SSD

- spațiu liber pe disc: 20–50GB

Pentru modele mai mari:

- 32GB RAM pentru modele 13 miliarde de parametri

- GPU dedicat pentru generare mult mai rapidă

Versiunile quantized (4-bit sau 8-bit) sunt preferate pentru rularea pe hardware obișnuit.

Performanțe excelente pentru o varietate de aplicații

În 2026 există numeroase modele LLM performante, iar diferența dintre modelele open-source și cele comerciale se reduce constant. Modele precum Llama, Mistral, DeepSeek, Phi, Qwen și Gemma oferă performanțe excelente pentru o varietate de aplicații.

În plus, datorită instrumentelor moderne precum LM Studio sau Ollama, aceste modele pot fi rulate local pe un computer obișnuit, fără infrastructură costisitoare.

Pe măsură ce hardware-ul devine mai puternic și modelele mai eficiente, AI local va deveni o componentă standard pentru dezvoltatori, companii și creatori de conținut.

PRODUSE RECOMANDATE