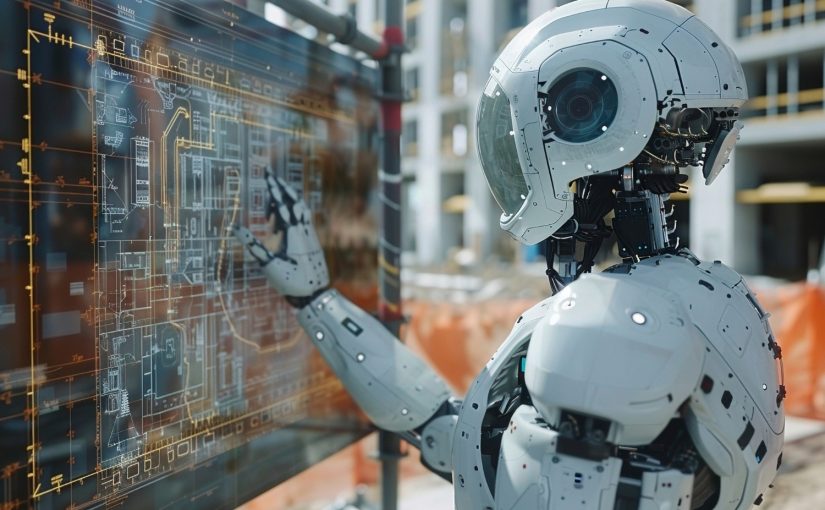

În 2026, cerințele pentru un PC performant au crescut semnificativ — un sistem care poate susține inteligența artificială (AI), gaming intens și multitasking puternic fără compromisuri este esențial pentru profesioniști și gameri deopotrivă. În acest ghid complet vei descoperi ce componente contează cu adevărat, cum să le alegi și cum să obții performanța maximă fără să depășești bugetul.

De ce ai nevoie de un PC puternic pentru AI, gaming și multitasking

Un PC destinat AI, gaming și multitasking trebuie să facă față unor sarcini diverse:

- algoritmi de inteligență artificială

- modele ML/Deep Learning

- jocuri AAA la detalii maxime

- editare video și randări 3D

- aplicații care rulează în paralel

Astfel, fiecare componentă are un rol crucial, iar alegerea corectă face diferența între un sistem decent și unul excepțional.

Componenta centrală: procesorul (CPU)

De ce contează CPU-ul pentru AI și multitasking

Procesorul este „creierul” PC-ului:

- Rulare modele AI și ML

- Multe fire de execuție în multitasking

- Încărcare ridicată în aplicații complexe

Recomandări de CPU pentru 2026

- High-End: AMD Ryzen 9 seria 8000 / Intel Core i9 seria 14

- Mid-Range: AMD Ryzen 7 / Intel Core i7

- Buget: AMD Ryzen 5 / Intel Core i5 (bun pentru gaming + multitask mediu)

Memorie RAM: cheia multitasking-ului

RAM suficient și rapid este critic pentru:

- modele AI care țin seturi de date în memorie

- gaming + programe deschise simultan

- browsing cu zeci de tab-uri

Recomandări RAM

- Minim: 32GB DDR5

- Ideal: 64GB DDR5

- Frecvență: 5200MHz sau mai mult

Placa video (GPU): motorul AI și gaming

GPU-ul și AI

GPU-urile moderne accelerează procesarea paralelă:

- inferență ML

- generare rapidă de date

- aplicații bazate pe OpenCL / CUDA

GPU pentru gaming

Pentru jocuri AAA la 4K fără lag:

- High-End: NVIDIA RTX 4080 / 4090 sau seria echivalentă AMD

- Mid: NVIDIA RTX 4070 / 4060

- Buget: NVIDIA GTX seria 30 / AMD RX seria 6000

Stocare rapidă: SSD NVMe

Un PC pentru AI, gaming și multitasking are nevoie de stocare rapidă:

- timpi de încărcare ultra-reduși

- transfereri rapide de date

- multitasking fluid

Sistem de răcire și airflow

Un sistem performant generează căldură, mai ales în:

- procesare AI

- sesiuni lungi de gaming

- task-uri CPU/GPU intense

Soluții de răcire recomandate

- Cooler CPU performant (aer sau AIO)

- Ventilatoare de carcasă eficiente

- Pastă termică de calitate

- Cable management pentru airflow optim

Sursă de alimentare (PSU) și stabilitate

O sursă stabilă asigură:

- tensiuni constante

- protecție la supratensiuni

- durabilitate

Recomandări PSU:

- High-End: 850W – 1000W 80+ Gold/Platinum

- Mid: 750W 80+ Gold

- Buget: 650W 80+ Bronze (pentru configurații mai mici)

Ce performanțe te poți aștepta în 2026

AI

- inferență locală rapidă

- rulare modele ML fără lag

- multitasking cu aplicații complexe

Gaming

- 144+ FPS în titluri competitive

- 4K sau 2K detalii ridicate

- VR și ray tracing fără probleme

Multitasking

- zeci de aplicații deschise simultan

- editing video fluent

- browsing intens + aplicații de muncă

📌 FAQ – întrebări frecvente

Ce specificații contează cel mai mult pentru AI și gaming?

Procesorul puternic și placa video de generație nouă sunt cele mai importante, urmate de RAM suficient și stocare rapidă SSD NVMe.

Pot să folosesc un SSD SATA pentru multitasking?

SSD-urile SATA sunt o îmbunătățire față de HDD, dar pentru multitasking intensiv și gaming, SSD NVMe este mult mai performant.

Cât RAM este suficient pentru AI?

Minim 32GB pentru multitasking și modele ML simple; 64GB sau mai mult pentru proiecte AI complexe.